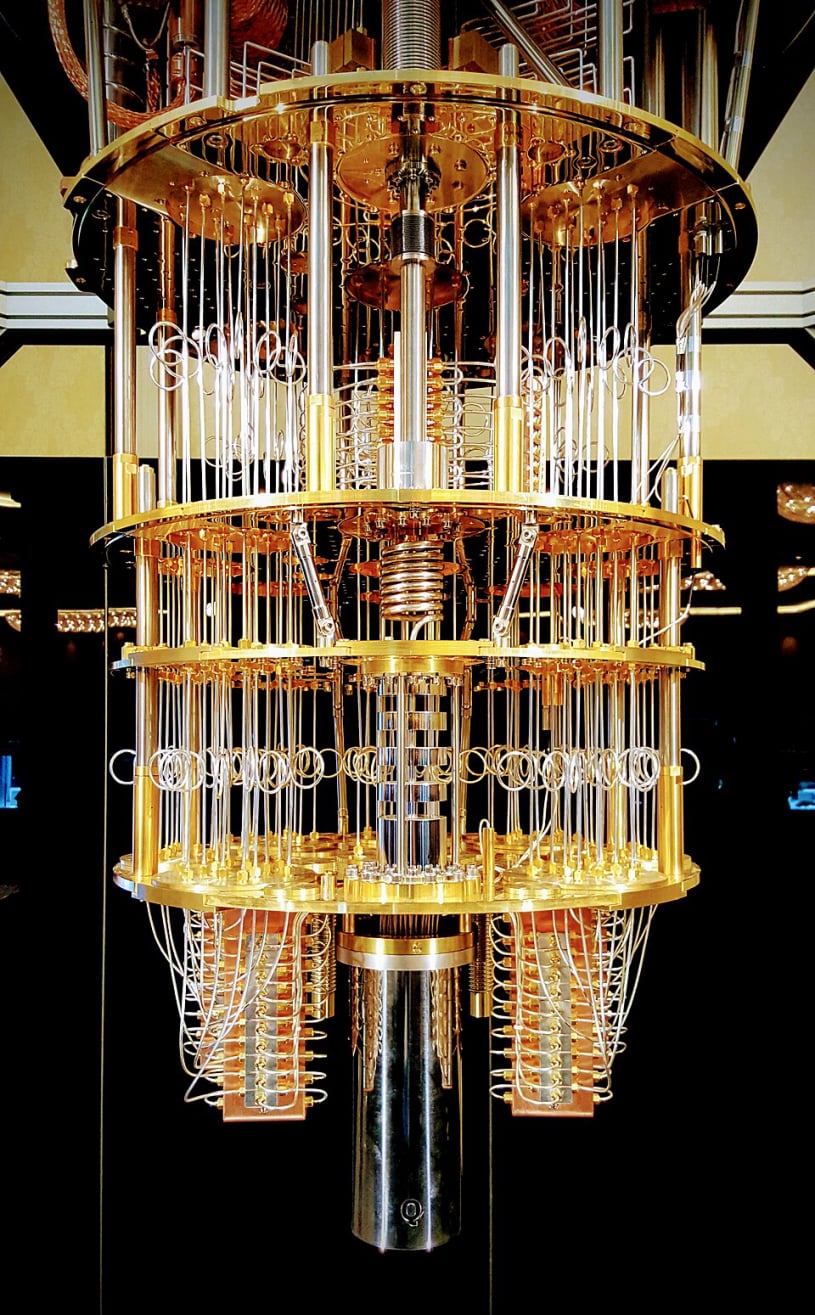

IBM Quantencomputer. Bildquelle: Lars Plugmann (CC BY-SA 2.0)

Quantencomputer sind bestimmte Ausprägungen eines Quantensystems. Dieses besteht aus einer kontrollierten Umgebung mit einer Menge von Quantenteilchen, z.B. mehreren Photonen oder mehreren Elektronen.

Die Schwierigkeit bei Quantencomputern besteht darin, die Quanten einerseits von ungewünschten Umwelteinflüssen abzuschirmen, andererseits aber kontrollierte Zustandsveränderungen zu erlauben (denn sonst könnte man das System ja nicht sinnvoll nutzen). Diese Systeme müssen deshalb sehr stark gekühlt werden.

Aufgrund des komplizierten Aufbaus und der damit verbundenen Kosten eines Quantencomputers sind die meisten dieser Systeme bei großen Firmen oder Regierungen installiert.

Bei der Funktionsweise eines Quantencomputers nutzt man physikalische Eigenschaften wie den Elektronenspin: Beim Messen dieser Eigenschaft kann der Spin entweder "Up" oder "Down" sein. Diese beiden Zustände werden im Quantencomputer auf sogenannte Qubits abgebildet.

Als Qubit bezeichnet man die kleinste Informationseinheit in der Quanteninformatik. Es kann anders als ein gewöhnliches Bit nicht nur die Zustände 0 und 1 annehmen, sondern auch Zustände "dazwischen", also Überlagerungen von 0 und 1.

Genau diese Eigenschaft macht Quantencomputer so besonders im Vergleich zu herkömmlichen Computern. Dahinter steckt das quantenphysikalische Phänomen der Superposition. In der Quantenphysik treten Zustände von Teilchen als Wahrscheinlichkeiten auf, somit befindet sich das Teilchen in einem "überlagerten Zustand" (vereinfacht ausgedrückt z.B. 75% Wahrscheinlichkeit Spin-Up, 25% Wahrscheinlichkeit Spin-Down). Erst wenn eine Messung erfolgt, "entscheidet" sich das Teilchen für genau einen dieser Zustände (zu den Themen Superposition, Wahrscheinlichkeiten und zur Rolle des Messvorgangs in der Quantenphysik finden Sie genauere Informationen auf unserer Artikelseite zum Doppelspaltexperiment).

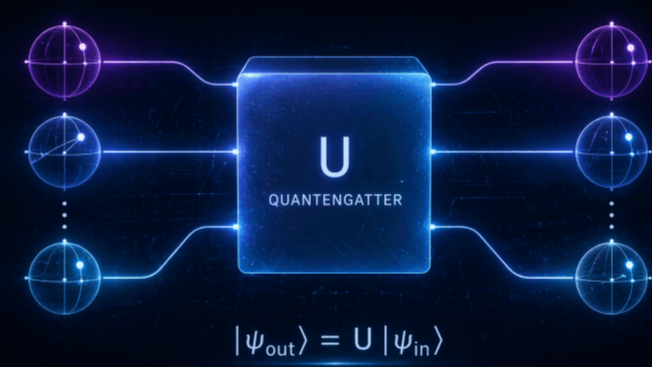

Der Trick beim Quantencomputing besteht nun darin, dem Benutzer Möglichkeiten zu bieten, den Zustand eines Teilchens (und damit eines "Qubits") kontrolliert zu beeinflussen, OHNE bereits eine Messung vorzunehmen, sodass man mit einer Überlagerung von Zuständen operieren kann. Denn das bringt einen entscheidenden Vorteil mit sich: